Siri没来!苹果AI终于不画大饼了,中国区依然遥遥无期 siri不见该咋办 苹果siri为啥不发展ai

北京时间 6 月 10 日凌晨 1 点,苹果准时拉开了一年一度的全球开发者大会(WWDC)的帷幕。但对苹果而言, 这绝非一场寻常的年度盛会。

整整一年前,市场曾对苹果的 AI 寄予厚望,期待其能够兑现 WWDC24 上的承诺,带来革命性的 AI 体验。然而理想是丰满的,现实是残酷的,Apple Intelligence 在过去一年进展缓慢、跳票不断,外界也开始对普遍质疑苹果的 AI 能力,以及未来的潜力。甚至,「苹果没救了」的论调都甚嚣尘上。

在这种背景下,WWDC25 来了。在刚刚结束的首日主题演讲上,苹果也改变了去年 Apple Intelligence「画大饼」的基调,在重重压力下,更务实地选择了在系统底层和基础功能上完善、扩展 AI 化。没有惊艳的突破性进展,但对第三方开发者以及应用生态确实带来不少好的变化。

不过生成式 AI 化的 Siri,依然遥遥无期,苹果软件工程高级副总裁 Craig Federighi 一开场就明确了「coming year(来年)」再议。那么,在这一次WWDC 25上,苹果分享了哪些AI方向上的动态呢?以下是雷科技的报道。

苹果 AI「大转弯」:认清现实,告别幻想

尽管正式演讲中,Craig 用 Apple Intelligence 做了开场,但在简单介绍 Apple Intelligence 已经「交付」的一些功能,并留下「设备端模型」—— Foundation 模型框架面向开发者开放的新消息后,迅速就转向了覆盖各大操作系统的「设计更新」。

图/苹果

事实上,苹果 WWDC25 上明显采取了稳健或者说保守的 AI 策略,而非追求引人注目的创新,提起「Apple Intelligence」的次数明显也比去年少了。总体来说,苹果这次更多是将 AI「有意义地」整合到操作系统或者第一方应用中,以及将「设备端模型」更大程度面向第三方开放。对于很多渴望看到苹果 AI「一鸣惊人」的投资者、媒体和用户来说,可能像泼了一盆冷水。

不过从现实的角度,苹果无论如何也不该重复去年的错误。

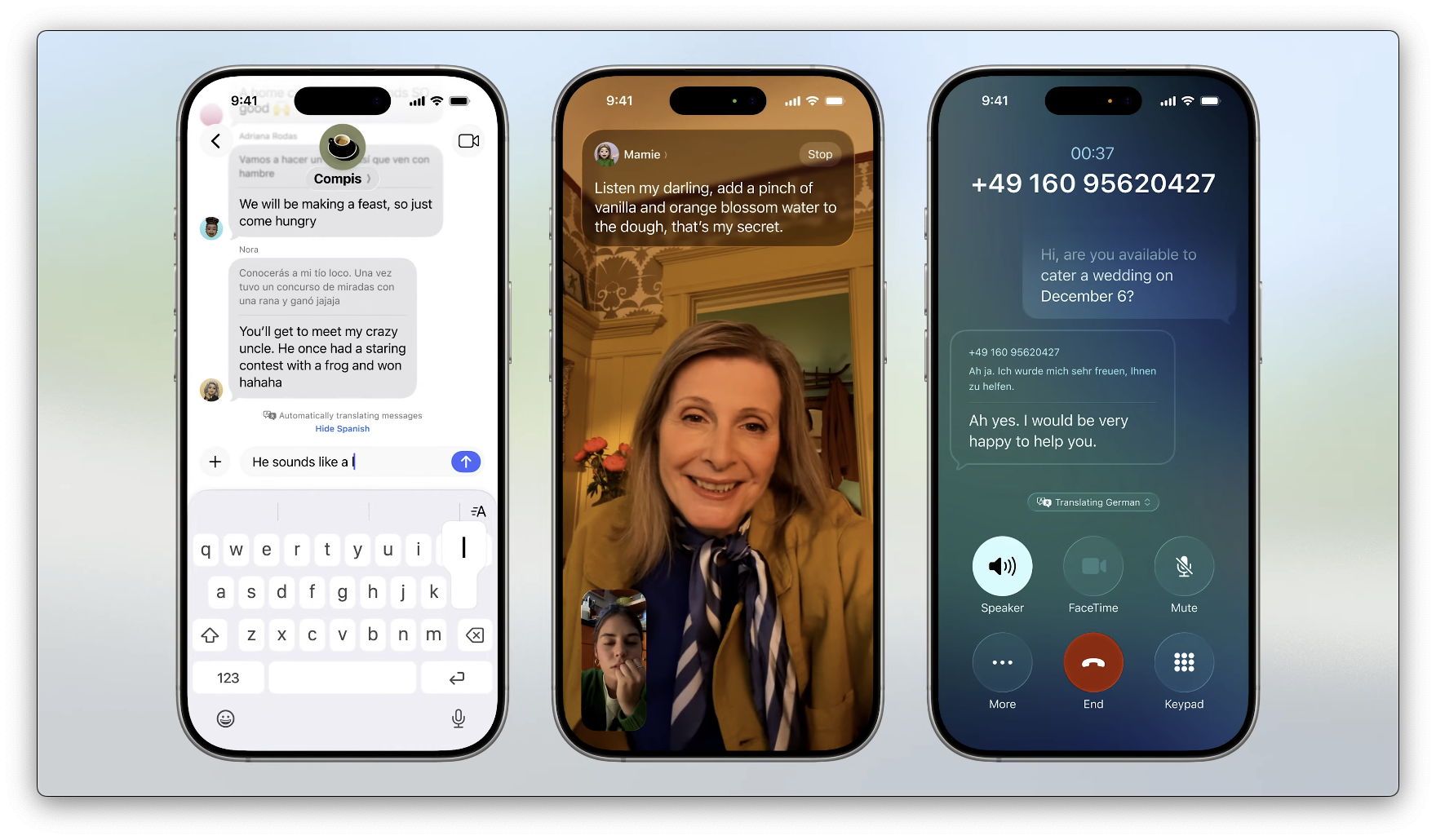

简言之,苹果这次在 AI 策略上选择了回归 WWDC 真正的含义——开发者大会。首先就具体介绍了覆盖苹果全部操作系统的全新翻译功能,支持电话(包括与非苹果设备)、FaceTime、Message 以及苹果音乐等等应用,并且面向开发者推出了新的翻译 API。

图/苹果

可以预计的是,第三方开发者一定乐意尝试和拥抱新的翻译 API,并应用在自己的 APP 中,毕竟直接利用了设备端模型和算力,免费的。但实际翻译表现如何,肯定还是开发者最终选择的关键之一。

此外,AI 也终于渗透到了苹果生态的开发端,苹果首次在 Xcode 上引入了 Vibe Coding,并且可以包括 ChatGPT 在内的不同模型。

苹果在智能视觉上也带来了更新。Craig 在 iOS 演讲的末尾带来了一个新的视觉智能功能,可以分析 iPhone 屏幕上的内容,像是对标 Google Gemini 的圈选搜索。但目前来看,这项功能以及更多的视觉智能似乎都由 ChatGPT 提供支持,包括 Image Playground 也支持了 ChatGPT 的图像生成。

只能说,苹果如果还是坚持自主训练大模型,在多模态方面真的要更努力。

与此同时,苹果也继续兑现了一些去年承诺的 AI 功能,包括 watchOS 的 Smart Stack(智能堆叠),基于 AI 预测用户需要的小部件(服务、工具和内容)。而之前传闻的「AI 引入快捷指令」,实际则是以 Intelligence actions 串起「聚焦」+「快捷指令」。

图/苹果

可以说,整体看下来 Apple Intelligence 确实没有太多惊喜,往好了说也避免了之后太多的惊吓。但苹果的执行力仍然是接下来的关键,按照给出的时间表,新系统的第一个开发者 Beta 版本当日即推送,公测版则从 7 月开始,并最终在 9 月推出正式版。

留给苹果 AI 的时间并不多。

从 Siri 到生态,苹果 AI 的冰与火之歌

但说了这么多,这一次的苹果 AI 目前仍然存在「画小饼」的可能,尤其是对于国内用户来说,Apple Intelligence 至今仍未上线,半点影子都还没看到。

事实上,苹果在 WWDC25 上还宣布了 Apple Intelligence 将在今年内推出繁体中文支持,支持中国香港 / 中国澳门 / 中国台湾等市场。至于简体中文的支持,其实已于今年 4 月在海外机型上率先实现,国内的上线时间主要取决于审核的进度。

图/苹果

而苹果,仍然没有给出明确的时间表。

这也包括无数苹果用户心心念念的新版 Siri,苹果在去年就承诺推出生成式 AI 化的 Siri,不仅更自然、更个性化、更深度地集成到系统中,还会具备屏幕感知、个人上下文和更深的应用集成能力,但现实却是一次又一次的推迟。按照演讲中的最新消息,新版 Siri 至少还要等到明年了。

一年之后又一年。可以说,新版 Siri 生成式 AI 化的继续跳票,始终是苹果 AI 战略中最尴尬的地方。更让人担忧的是,苹果这次甚至没有针对新版 Siri 介绍任何可能的进展或者更新,更进一步说明了目前的进展缓慢。

不过,苹果在 AI 时代的优势仍然无法忽略,即便当前功能不算抢眼,底层能力依然具备明显差异化优势。

图/苹果

一方面是在 AI 普遍引发隐私担忧的时代,苹果坚持的「设备端 AI」策略显得尤为突出。这种方法利用针对设备本地处理优化的「小型 AI 模型」,旨在确保「用户隐私和高效处理」的兼顾,而无需依赖基于云的解决方案。对于需要更强大算力的任务,苹果则引入了「私有云计算」——承诺不存储数据,提供「可验证的隐私承诺」。

这种对隐私的「偏执」强调,虽然被认为是苹果 AI 进展缓慢的「元凶」之一,但也是苹果在 AI 领域的核心竞争力。通过在本地或高度安全、透明的云环境中处理敏感数据,苹果旨在建立无与伦比的用户信任,并将其自身与过度依赖集中化、不透明数据处理的竞争对手区分开来。

另一方面,苹果也在 WWDC25 上再次展示了跨系统的生态能力,从基础 AI 能力全线打通 iOS、iPadOS、macOS、tvOS、watchOS、visionOS,再到提供给第三方开发者相应的 API,这是其他厂商都还做不到的,即便是 Google。

图/苹果

而这也意味着,即便当下苹果在 AI 应用上的进展相对缓慢,但实际 AI 在苹果生态渗透的深度和广度都还有一定优势。关键还在于,这种优势还会选择第三方开发者的加入「非线性增长」。

还有一点容易被忽视的是,这次苹果宣布了全生态操作系统的「统一」设计升级,从 iOS 到 tvOS。而统一的设计可以减少了用户的认知负担,使得跨设备(例如在 iPhone 上开始任务,在 Mac 上继续)的 AI 功能感觉更直观、更协调、真正集成。

所以不仅是像 visionOS 的设计风格趋近,这次统一的设计升级可能也是苹果为更深层次、更普遍的 AI 集成做好整个生态系统的准备,确保 AI 驱动的交互感觉原生、流畅和一致,而不是被视为附加功能。

写在最后:苹果AI不求速胜,打持久战

图/苹果

WWDC25 或许在 AI 上没有什么惊喜,但苹果至少走在了正确的道路上,在模型始终无法取得重大突破的情况下,将 AI 通过深层集成、开发者赋能的方式,真正落地到用户的实际体验之中。不求惊艳,但求有用。

或许在短期内,苹果依然会面对 AI 进展落后的压力的批评。但今天不管是 AI 手机、AI PC,还是其他 AI 设备,实际上都处在挖掘 AI 价值的很早期,用户真正能感受到的也很少,苹果还有不少的机会和时间。尤其考虑到苹果强大的生态系统「粘性」——对用户,也对开发者,这将非常有助于第三方 AI 应用的涌现,形成良性循环。

从这个角度来看,WWDC25 可能会是苹果在这场 AI 马拉松中,调整姿态、积蓄力量的关键窗口。